新模型在Hugging Face开放访问大型语言模型(LLM)排行榜上位列第一

拥有1800亿参数的模型在3.5万亿个词元(Token)上进行训练,计算资源是Meta LLaMA 2的4倍

Falcon 180B对研究人员和商业用户开放

阿联酋阿布扎比--(美国商业资讯)--阿联酋的Technology Innovation Institute(TII)推出了Falcon 180B,这是其旗舰大型语言模型(LLM)的高级迭代,再次突破了生成式人工智能的界限。这一突破性的发布加强了阿联酋在人工智能领域的主导地位,提供Falcon 180B作为研究和商业用途的开放访问模型。

本新闻稿包含多媒体。此处查看新闻稿全文: https://www.businesswire.com/news/home/20230906602204/zh-CN/

继Falcon 40B这一开源人工智能模型于2023年5月迅速登上Hugging Face LLM排行榜榜首并大获成功后,阿布扎比高级技术研究委员会(ATRC)的应用研究支柱TII继续引领生成式人工智能的发展。Falcon 40B标志着为研究人员和商业用户提供的开源模型的首批实例之一,其被认为是该领域具有突破性的先驱产品。

高级技术研究委员会秘书长Faisal Al Bannai阁下强调了Falcon对人工智能领域的积极影响,并表示:“我们设想在未来世界中,人工智能的变革力量触手可及。我们致力于实现先进人工智能获取的民主化,因为我们的隐私和人工智能对人类的潜在影响不应被少数人控制。虽然我们可能不知道所有答案,但我们的决心仍然坚定不移,即开展合作并为开源社区做出贡献,确保所有人都能共享人工智能的益处。”

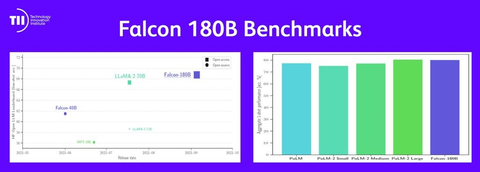

Falcon 180B拥有惊人的1800亿个参数,并在3.5万亿个词元上进行了训练,一跃成为Hugging Face预训练LLM排行榜的榜首。它在各种基准测试中(包括推理、编码、熟练程度和知识测试)都优于Meta的LLaMA 2等著名竞争对手。

在最好的闭源LLM中,Falcon 180B仅次于OpenAI最新的GPT 4,与Google的PaLM 2 Large性能不相上下,后者是为Bard提供支持的模型,但Falcon 180B只有该模型的一半大小。该模型的许可框架基于“Falcon 180B TII许可证”,该许可证以Apache 2.0为基础。

TII的AI Cross-Center部门执行主任兼代理首席研究员Ebtesam Almazrouei博士表示:“Falcon 180B的发布体现了我们致力于推进人工智能前沿科技的决心,我们很高兴能与世界分享其无限的潜力。Falcon 180B预示着一个生成式人工智能的新时代,在这个时代,科学进步的潜力可以通过开放获取资源来为明天的创新提供动力。当我们深入研究科学和技术的前沿时,我们的愿景远不至于创新;而是要培育一种深刻的互联关系,以通过合作性的突破来应对全球挑战。”

随着超过1200万开发人员采用和部署Falcon的第一个版本,这一重大升级将成为从聊天机器人到代码生成等各个领域的首要模型。

Falcon 180B兼容以下主要语言:英语、德语、西班牙语和法语,并提供对意大利语、葡萄牙语、波兰语、荷兰语、罗马尼亚语、捷克语和瑞典语的有限支持。

若要了解更多信息,请访问FalconLLM.tii.ae

来源:AETOSWire

免责声明:本公告之原文版本乃官方授权版本。译文仅供方便了解之用,烦请参照原文,原文版本乃唯一具法律效力之版本。

在 businesswire.com 上查看源版本新闻稿: https://www.businesswire.com/news/home/20230906602204/zh-CN/

CONTACT:

Jennifer Dewan,高级传播总监

jennifer.dewan@tii.ae

Falcon 180B基准(照片:AETOSWire)